在日常运维中,Linux系统日志出现中文乱码是最让人头疼的问题之一。无论是查看应用程序日志、系统安全日志,还是cron任务输出,一旦遇到中文变成乱码,排错效率会直线下降。本文将从编码原理入手,结合实际操作,帮你彻底理清Linux日志中文乱码的根源,并提供可直接复用的解决方案。

日志乱码原因是什么

导致Linux日志中文乱码的核心原因是字符编码不匹配。Linux系统默认使用UTF-8编码,但某些老旧的应用程序或脚本可能输出GBK、GB2312等编码的中文。当日志写入工具使用的编码与读取终端或日志查看器预期的编码不一致时,中文就会被解析成乱码。此外,SSH客户端本身的编码设置、文件传输过程中的编码转换错误,也会引发类似问题。

另一个容易被忽略的原因是Locale环境变量未正确配置。如果系统的LANG或LC_ALL变量被设置为C或POSIX,系统将使用ASCII编码,所有非ASCII字符都会显示为问号或乱码。同样,如果用户手动修改了/etc/locale.conf或~/.bashrc中的编码设置,但没有重启会话或服务linux手机软件,也会导致日志输出异常。检查这些基础环境是排查乱码的第一步。

如何查看文件真实编码

使用file命令可以快速检测日志文件的编码格式。例如执行file -i /var/log/messages,输出中的charset字段会显示如us-ascii、utf-8或iso-8859-1等值。如果文件原本是GBK编码却被标记为unknown-8bit,说明系统无法自动识别,需要人工确认。此时可以用iconv -f gbk -t utf-8 日志文件尝试转换后预览内容。

另一种方法是直接用hexdump -C查看文件的十六进制表示。中文字符在UTF-8中通常占3个字节,在GBK中占2个字节。通过观察字节模式可以反推编码。例如看到连续两个高位字节(如D6 D0),大概率是GBK编码;而看到E4 B8 AD这样的三字节序列,则属于UTF-8。掌握了这个技巧,即使没有工具也能初步判断编码类型。

终端显示乱码怎么修复

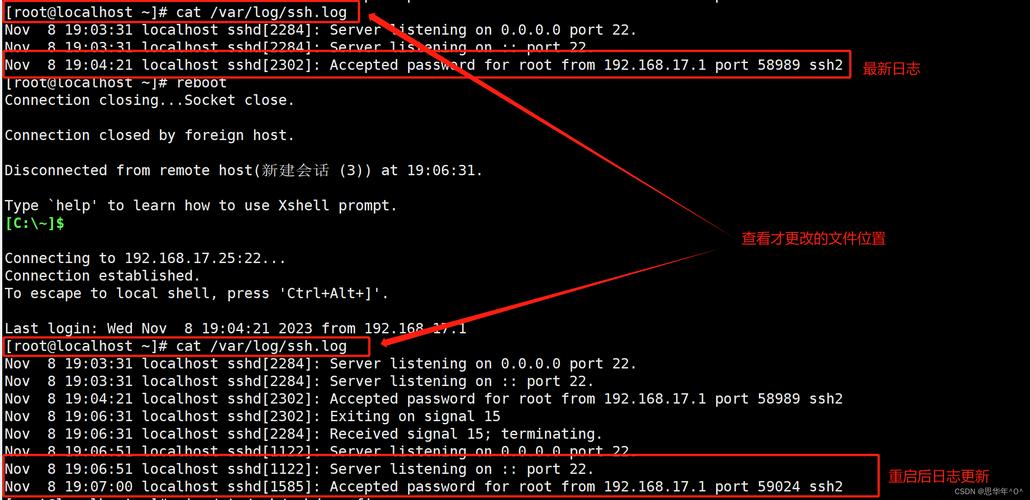

如果是通过SSH或本地终端查看日志时出现乱码,首先检查终端软件的字符集设置。Xshell、SecureCRT等工具需将编码设为UTF-8,并确保“转换粘贴的文本”选项正确。对于GNOME终端或KDE Konsole,可以在配置文件中设置LANG=zh_CN.UTF-8,然后重新打开终端。临时解决可以执行export LANG=zh_CN.UTF-8 && export LC_ALL=zh_CN.UTF-8linux 日志中文乱码,再用cat或tail查看日志。

更彻底的修复方法是重新生成系统的locale支持。运行locale -a查看已安装的语言包,如果没有zh_CN.UTF-8,执行sudo locale-gen zh_CN.UTF-8。然后编辑/etc/default/locale文件,写入LANG="zh_CN.UTF-8"。注意某些发行版使用/etc/locale.conf。修改后需要重启系统或重新登录SSH会话,否则环境变量不会立即生效。另外,systemd服务可能继承启动时的编码,建议重启相关服务。

如何永久解决乱码问题

永久解决日志中文乱码,需要从日志产生源头统一编码。对于自己编写的脚本或程序,输出日志前强制将字符串转换为UTF-8。Python中可使用.encode('utf-8')linux 日志中文乱码,Java中使用new String(str.getBytes("GBK"), "UTF-8")。对于第三方应用如Nginx、MySQL,检查它们的配置文件,找到charset或character-set-server参数,统一设为utf8mb4。

如果无法修改应用程序编码,可以编写一个日志过滤脚本。使用stdbuf -oL实时调整输出缓冲区,并通过管道传递给iconv -f gbk -t utf-8进行动态转换。例如./app | iconv -f gbk -t utf-8 >> /var/log/app.log。或者用systemd单元文件中的StandardOutput=syslog配合rsyslog的omprog模块完成转换。这种方法不需要改动原程序,适合快速解决存量乱码问题。

Linux系统日志乱码排查步骤

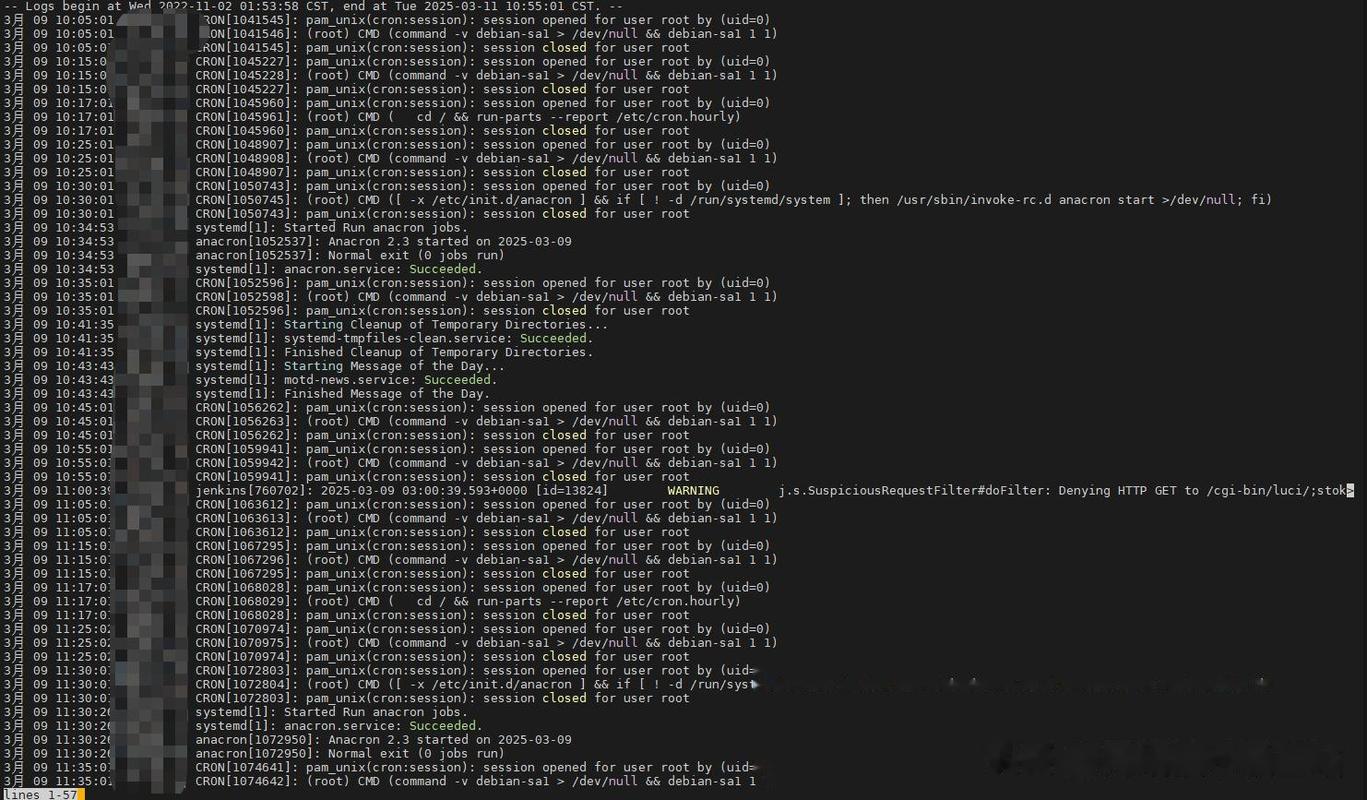

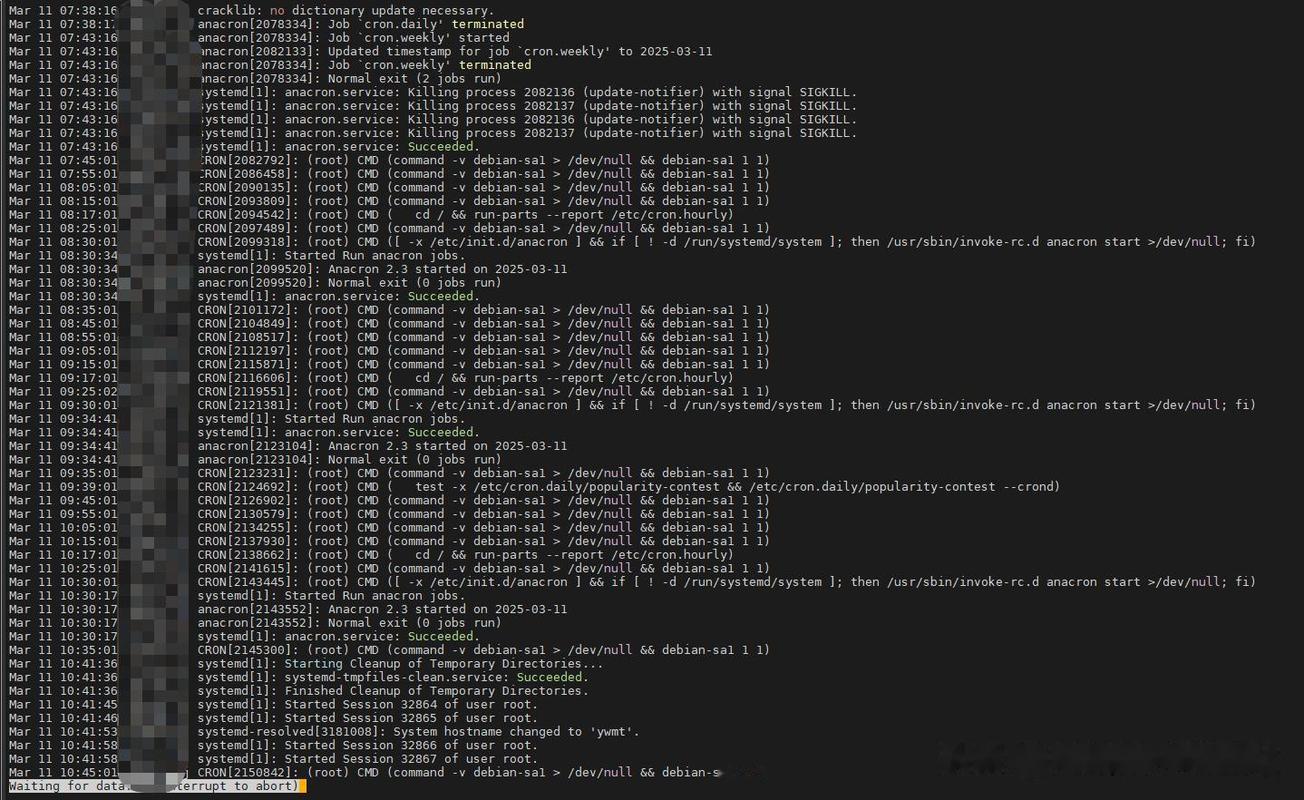

排查乱码问题时,建议按以下顺序操作。第一步确认终端编码:执行echo $LANG,确保返回zh_CN.UTF-8或en_US.UTF-8。第二步检查日志文件编码:file -i 日志文件名,记录charset值。第三步测试显示:分别用cat、less、vim打开同一个文件,看乱码表现是否一致。如果只有less乱码arch linux,可能是less的-r参数问题,添加-R选项即可。

第四步分析原始字节:hexdump -C 日志文件名 | head,观察中文字节的十六进制模式。第五步尝试转换:iconv -f 原编码 -t utf-8 日志文件名 -o 新文件,然后用tail查看新文件。如果转换失败,说明文件包含混合编码或损坏字节,可使用recode工具强制处理。最后检查写入日志的进程:lsof | grep 日志文件名,找到进程ID后查看/proc/进程ID/environ中的LANG设置。

vim查看日志乱码处理

使用vim查看日志时出现乱码,大多是因为vim没有自动识别文件编码。在vim中执行:set fileencoding,如果显示fileencoding=latin1,说明识别错误。此时执行:set fileencoding=utf-8然后:wq!保存退出,再重新打开就能正常显示。更优雅的方式是在~/.vimrc中添加set fileencodings=utf-8,gbk,gb2312,cp936,让vim按优先级自动尝试解码。

如果日志文件非常大,不建议直接用vim打开。可以使用vim -R只读模式,并关闭语法高亮和插件加速加载。另外,在vim命令行模式下输入:e ++enc=gbk可以强制以GBK编码重新加载当前文件,无需修改原文件编码。对于持续输出的动态日志,推荐结合tail -f和less -R,或者用multitail工具支持多编码同时查看,这样既不会卡死编辑器,也能实时监控。

你平时在排查Linux日志乱码时,还遇到过哪些特殊的编码陷阱?欢迎在评论区分享你的实战经验,点赞收藏本文,下次遇到乱码问题就能快速找到解决方案。