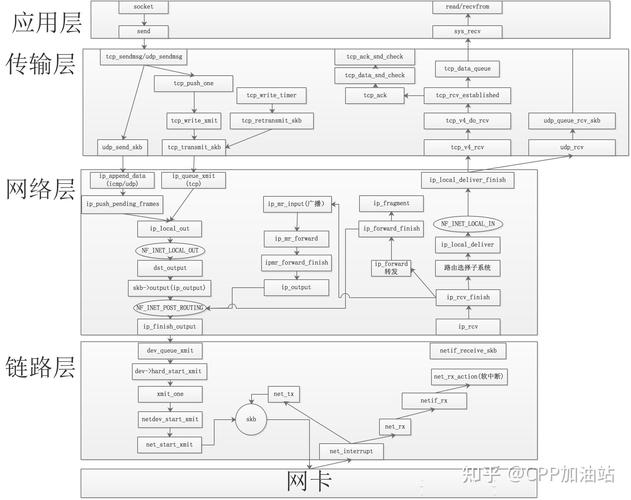

要真正理解Linux网络协议栈的运行机制,最直接的方式就是亲自追踪TCP/IP代码的执行路径。无论是排查网络性能问题,还是学习内核网络实现,掌握追踪方法都能让你从“黑盒使用”走向“白盒洞察”。本文将从实战角度出发,介绍六种核心技巧,帮助你一步步走进Linux内核网络源码的世界。

如何设置内核断点追踪tcp/ip

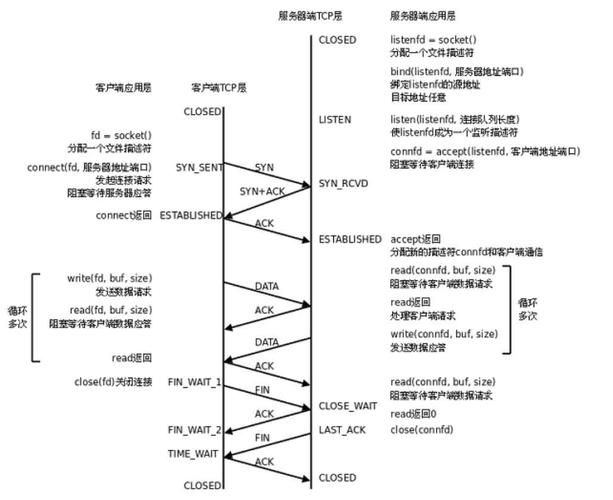

使用KGDB或QEMU+GDB是最基础的断点调试方法。你需要在编译内核时开启CONFIG_DEBUG_INFO和KGDB选项,然后在虚拟机中通过串口或网络连接主机GDB。在GDB中,输入break tcp_v4_connect即可在TCP主动连接建立函数上设断点,执行continue后,当系统发起TCP连接时就会触发断点。建议配合list命令查看上下文代码,用print sk->sk_dport打印目标端口,观察数据结构实时变化。

除了虚拟机,你还可以用Ftrace的function_graph模式设置动态断点。通过echo tcp_v4_connect > /sys/kernel/debug/tracing/set_ftrace_filter,再启用function_graph后,内核会打印出该函数的所有调用子函数和返回时间。这种方法比传统GDB更轻量,适合在生产环境或容器中临时追踪,不影响正常网络吞吐,而且不需要重新编译内核。

tcp/ip代码调用链分析工具对比

SystemTap是最早的跟踪框架之一,通过脚本语言在内核函数入口和出口插入探针。例如probe kernel.function("tcp_recvmsg") { printf("%sn", backtrace()); }可以直接输出TCP接收数据的完整调用栈。它的优点是语法灵活,缺点是需要安装大量的调试符号和内核开发包,对新手门槛较高。

BPF工具链(如bpftrace和BCC)现在是主流选择。使用bpftrace -e 'kprobe:tcp_rcv_established { printf("%sn", kstack()); }'可以实时打印TCP已建立连接状态下收包的内核栈。相比SystemTap,BPF更安全、性能开销更低,且支持动态加载。此外追踪linux tcp/ip代码运行,bpftrace还支持kretprobe捕获返回值,方便分析错误码追踪linux tcp/ip代码运行,是追踪TCP/IP代码的首选工具。

怎样使用ftrace追踪tcp重传

TCP重传是网络故障排查的关键节点。要追踪重传相关代码,首先进入ftrace目录:cd /sys/kernel/debug/tracing,设置echo tcp_retransmit_skb > set_ftrace_filter,然后echo function > current_tracer并echo 1 > tracing_on。当内核执行重传函数时,trace文件中会记录函数入口参数(如skb指针)linux版qq,你可以通过cat trace | grep tcp_retransmit_skb过滤出具体调用时间戳和进程ID。

更深入的分析需要追踪重传定时器和拥塞状态机。使用echo tcp_write_timer > set_ftrace_filter并开启function_graph,能看到tcp_write_timer如何触发tcp_retransmit_skb。同时,配合echo tcp_congestion_control > set_ftrace_filter可以观察cubic或bbr算法在重传时的加减窗操作。这样完整的重传处理流程就从定时器到报文发送全部暴露出来了。

如何动态跟踪tcp/ip内核数据包路径

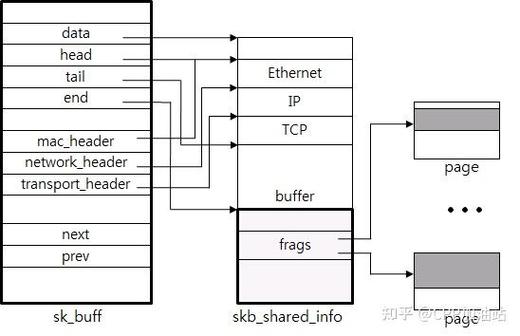

使用skb(socket buffer)标记法可以跟踪一个数据包的完整生命周期。在内核代码中插入pr_debug或trace_printklinux怎么读,打印skb的hash值和数据指针。例如在net/ipv4/tcp_input.c的tcp_v4_rcv处加入trace_printk("tcp_v4_rcv: skb=%pn", skb),重新编译内核模块后启动,通过dmesg观察同一个skb地址如何经过tcp_v4_do_rcv、tcp_rcv_state_process等函数。

另一种更高效的方法是使用perf的record和script。执行perf record -e skb:kfree_skb -ag捕获丢包事件,再用perf script显示内核栈和skb地址。然后反向查找:在源码中搜索对应skb地址被分配的路径(如alloc_skb),结合kprobe追踪该地址后续的传递过程。这种方法能快速定位数据包在哪个函数被丢弃,非常适合诊断网络丢包类问题。

tcp/ip代码调试的常见陷阱与对策

很多人追踪代码时发现函数入口被调用多次却无法对应实际报文,原因在于软中断上下文异步执行。例如tcp_v4_rcv运行在NET_RX软中断中,而应用层系统调用如sendmsg运行在进程上下文。打印日志时要同时记录current->pid和orig_pid,否则容易混淆。解决方法是使用tsc时间戳配合每CPU变量来区分不同CPU上的并发执行流。

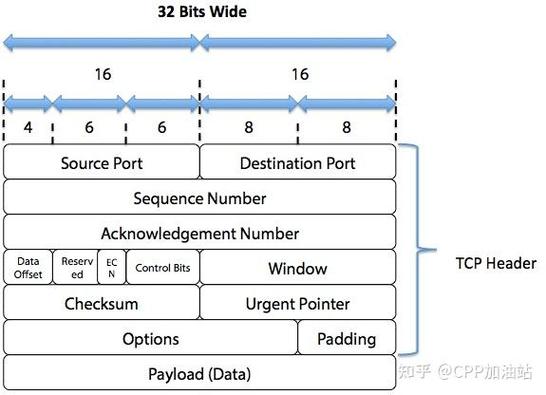

另一个陷阱是内联函数和宏展开导致断点失效。很多TCP/IP关键逻辑(如tcp_sk、tcp_hdr)都是内联的,GDB无法直接打断点。这时需要改用kprobe技术,在非内联包装函数上设置探针,比如kprobe:tcp_sendmsg实际调用了tcp_sendmsg_locked。推荐先用objdump -d vmlinux | grep 函数名确认符号是否独立存在,若不存在则寻找上层调用函数,避免浪费时间在无效断点上。

追踪tcp/ip源码的实战演练步骤

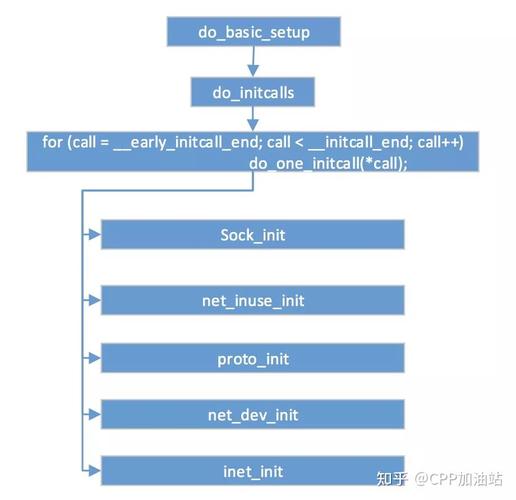

第一步,准备带有调试符号的内核和对应版本的源码,使用make menuconfig开启CONFIG_DEBUG_KERNEL和CONFIG_KPROBES。启动目标机后挂载debugfs。第二步,运行一个简单的TCP客户端和服务器(比如nc -l 8080和nc 127.0.0.1 8080),业务简单便于控制代码路径。第三步,用bpftrace写下探针脚本,例如追踪tcp_accept之后的握手过程:kprobe:tcp_v4_syn_recv_sock { printf("syn recv sock from %dn", pid); }。

第四步,手动触发连接并观察探针输出。你会发现三次握手中还调用了tcp_conn_request、tcp_check_req等子函数。将感兴趣的函数逐一加入追踪列表,画出调用时序图。最后一步,修改内核参数触发特定行为,比如设置net.ipv4.tcp_sack=0,追踪tcp_sack相关的处理分支。通过对比不同配置下的代码走向,你能深刻理解每个条件语句的实际作用。

你在追踪Linux TCP/IP代码时遇到过哪些让你困惑的函数调用链?欢迎在评论区分享你的调试经历或提问,点赞过100我将继续分享TCP拥塞控制算法的源码追踪技巧。