在互联网大厂的运维场景中,服务器存储架构往往复杂多样 —— 从本地 SAS 硬盘到分布式存储,从物理机到容器化部署,磁盘挂载始终是连接存储资源与业务系统的关键环节。无论是新服务器上架、存储扩容,还是故障恢复后的数据迁移,都离不开标准化的磁盘挂载操作。

大厂运维对磁盘挂载的核心诉求集中在三点:稳定性(避免挂载失效导致服务中断)、安全性(防止误操作造成数据丢失)、可维护性(适配自动化运维流程)。根据某云厂商运维白皮书统计,未规范执行磁盘挂载流程引发的故障占比达 23%,其中 80% 集中在「永久挂载配置错误」「文件系统不兼容」「权限分配不当」三大问题上。因此,掌握标准化的磁盘挂载方法,是大厂运维人员必备的核心技能。

Linux 磁盘挂载的底层逻辑是什么?

要做好磁盘挂载,首先要理解其底层原理,避免「知其然不知其所以然」。

1. 核心概念拆解2. 挂载的底层流程系统识别磁盘设备(通过udev服务自动生成/dev下的设备文件);运维人员对设备进行分区、格式化(创建文件系统);创建挂载点目录(需确保目录为空,避免覆盖原有数据);通过mount命令建立设备文件与挂载点的关联(底层是将文件系统的 inode 树挂载到系统的全局 inode 树中);配置/etc/fstab实现永久挂载(系统启动时读取该文件,自动完成挂载)。大厂标准的 Linux 磁盘挂载步骤(以 CentOS 7/8 为例)

结合大厂运维规范,以下是从设备识别到永久挂载的完整实操流程,包含详细命令与参数说明:

步骤 1:识别新磁盘设备

登录服务器后,首先确认新增磁盘的设备名称,避免误操作现有磁盘:

# 方法1:查看磁盘分区信息(推荐,直观显示设备、容量、分区情况)

fdisk -l

# 方法2:查看磁盘挂载状态(对比已挂载设备,识别新磁盘)

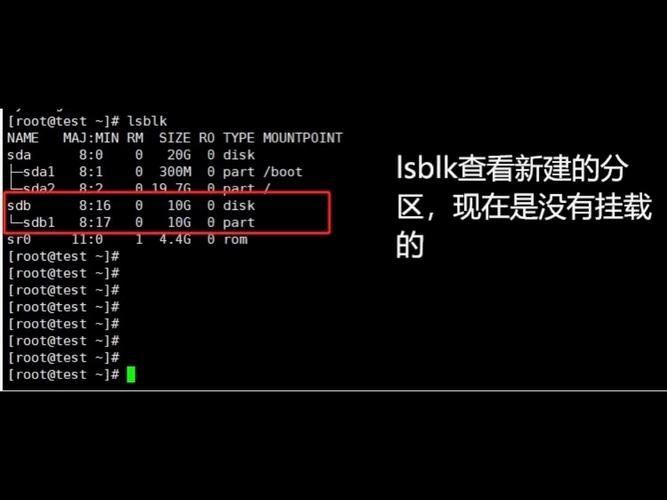

lsblk

# 方法3:通过/proc文件系统查看(底层数据,适用于自动化脚本)

cat /proc/partitions关键判断:新磁盘通常未显示挂载点(MOUNTPOINT为空),且无分区信息(例如sdb无sdb1分区)。

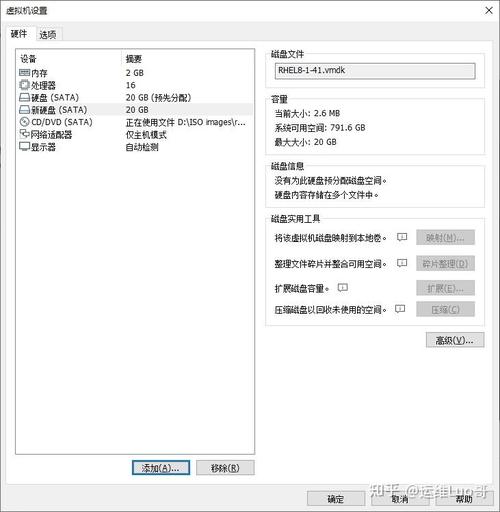

步骤 2:磁盘分区(可选,根据需求划分逻辑分区)

若需将磁盘划分为多个分区(如系统盘与数据盘分离),使用fdisk或parted工具,大厂推荐parted(支持 GPT 分区表,适用于 2TB 以上大磁盘):

# 1. 进入parted工具,指定操作磁盘(以/dev/sdb为例)

parted /dev/sdb

# 2. 查看磁盘当前分区表类型(MBR适用于2TB以下,GPT适用于2TB以上)

(parted) print

# 3. 若为新磁盘,创建GPT分区表(可选,根据磁盘容量选择)

(parted) mklabel gpt

# 4. 创建分区(例如创建1个100GB的主分区,挂载到/data)

(parted) mkpart primary xfs 0% 100GB # primary表示主分区,xfs指定文件系统类型,0%为起始位置,100GB为结束位置

# 5. 验证分区是否创建成功

(parted) print

# 6. 退出parted工具

(parted) quit注意:生产环境中,数据盘建议单独分区,避免与系统盘(/分区)共用,降低磁盘满导致系统崩溃的风险。

步骤 3:格式化分区(创建文件系统)

分区完成后,需格式化分区为指定文件系统linux扫描新增磁盘,大厂常用xfs或ext4:

# 格式化为xfs文件系统(推荐,性能更优)

mkfs.xfs /dev/sdb1

# 若需格式化为ext4文件系统

mkfs.ext4 /dev/sdb1验证:格式化完成后,通过blkid /dev/sdb1命令查看文件系统类型与 UUID(UUID 用于/etc/fstab配置linux 常用命令,比设备名称更稳定)。

步骤 4:创建挂载点并挂载

# 1. 创建挂载点目录(大厂规范:数据存储用/data,备份用/mnt/backup,根据业务命名)

mkdir -p /data

# 2. 临时挂载(测试是否正常,生产环境需后续配置永久挂载)

mount /dev/sdb1 /data

# 3. 验证挂载是否成功(查看挂载状态,确认/dev/sdb1与/data关联)

mount | grep /data

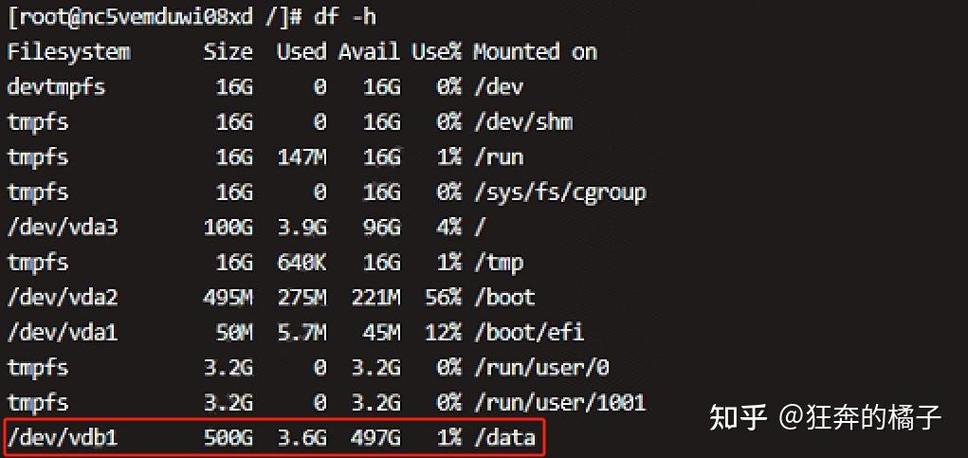

df -h /data # 查看挂载点的磁盘容量关键检查:挂载后需确认/data目录下无原有数据(若有数据linux扫描新增磁盘,说明挂载点非空,需立即卸载并清理目录)。

步骤 5:配置永久挂载(核心步骤linux 版本,大厂运维重点核查项)

临时挂载重启后失效,需配置/etc/fstab实现永久挂载,配置错误可能导致系统无法启动,需严格遵循以下规范:

# 1. 查看磁盘分区的UUID(推荐用UUID配置,避免设备名称变更导致挂载失效)

blkid /dev/sdb1 # 输出示例:/dev/sdb1: UUID="xxx-xxx-xxx" TYPE="xfs"

# 2. 编辑/etc/fstab文件(使用vim,需root权限)

vim /etc/fstab

# 3. 在文件末尾添加以下配置(格式:UUID=xxx 挂载点 文件系统 挂载参数 0 0)

UUID=xxx-xxx-xxx /data xfs defaults 0 0参数说明(大厂标准配置):

步骤 6:验证永久挂载配置

配置完成后,必须验证是否正确,避免重启后故障:

# 1. 重新加载/etc/fstab配置,测试挂载

mount -a

# 2. 无报错则说明配置正确,再次验证挂载状态

df -h /data

# 3. (可选)模拟重启后的挂载情况(大厂运维常用)

umount /data # 卸载临时挂载

mount -a # 重新读取fstab并挂载

df -h /data # 确认挂载成功应急处理:若mount -a报错,立即排查/etc/fstab配置(如 UUID 错误、文件系统类型错误、挂载点不存在),修改后重新测试,直至无报错。

经验总结:大厂运维避坑指南与最佳实践1. 高频踩坑点及解决方案

踩坑场景

错误原因

解决方案

重启后挂载失效

未配置/etc/fstab,仅使用mount临时挂载

按步骤 5 配置/etc/fstab,并执行mount -a验证

系统无法启动

/etc/fstab配置错误(如 UUID 写错、挂载点不存在)

开机时按 e 进入 grub 编辑模式,在 linux16 行末尾添加init=/bin/bash,进入单用户模式修改/etc/fstab

挂载后数据丢失

挂载点目录非空,覆盖原有数据

卸载磁盘(umount /data),恢复挂载点目录数据后重新挂载

磁盘满导致服务异常

未单独分区,数据盘与系统盘共用

新增数据盘,按流程挂载到/data,将业务数据迁移至新挂载点

挂载后权限不足

挂载点目录权限未配置

执行chmod 755 /data或chown app:app /data(根据业务用户调整)

2. 大厂最佳实践结语

Linux 磁盘挂载看似简单,实则暗藏诸多细节,尤其是在大厂高可用、高并发的运维场景中,任何一个小失误都可能引发生产故障。掌握「原理 + 实战 + 避坑」的完整知识体系,不仅能提高日常运维效率,更能体现专业运维人员的核心竞争力。

如果您在实际操作中遇到特殊场景(如 LVM 逻辑卷挂载、NFS 共享存储挂载、容器化环境挂载),欢迎在评论区留言交流,后续将针对性分享更深入的实战技巧!